Was sind RAG-Systeme und wie funktionieren sie?

Retrieval-Augmented Generation (RAG) revolutioniert die Art, wie KI-Systeme mit Unternehmenswissen arbeiten.

In den letzten Jahren hat sich Künstliche Intelligenz (KI) rasant weiterentwickelt – vor allem im Bereich der Large Language Models (LLMs) wie GPT, LLaMA oder Claude. Doch trotz ihrer beeindruckenden Fähigkeiten haben diese Modelle eine große Schwäche: Sie können nur auf dem Wissen basieren, das in ihren Trainingsdaten enthalten ist.

Genau hier kommen RAG-Systeme (Retrieval-Augmented Generation) ins Spiel. In diesem Artikel erklären wir dir, was RAG-Systeme sind, wie sie funktionieren und warum sie zu den wichtigsten Entwicklungen in der modernen KI zählen.

Was sind RAG-Systeme?

RAG steht für Retrieval-Augmented Generation. Es handelt sich dabei um eine KI-Architektur, die ein Sprachmodell (LLM) mit einem Informationsabruf-System kombiniert.

Statt dass das LLM allein Antworten generiert, werden externe Wissensquellen – wie Datenbanken, Dokumentensammlungen oder das Web – in den Prozess integriert. Das Modell kann dadurch aktuelles, faktenbasiertes und kontextbezogenes Wissen abrufen, bevor es eine Antwort formuliert.

Kurz gesagt:

👉 Ein RAG-System verbindet die Sprachkompetenz eines LLMs mit der Wissensgenauigkeit einer Suchmaschine oder Datenbank.

Wie funktionieren RAG-Systeme?

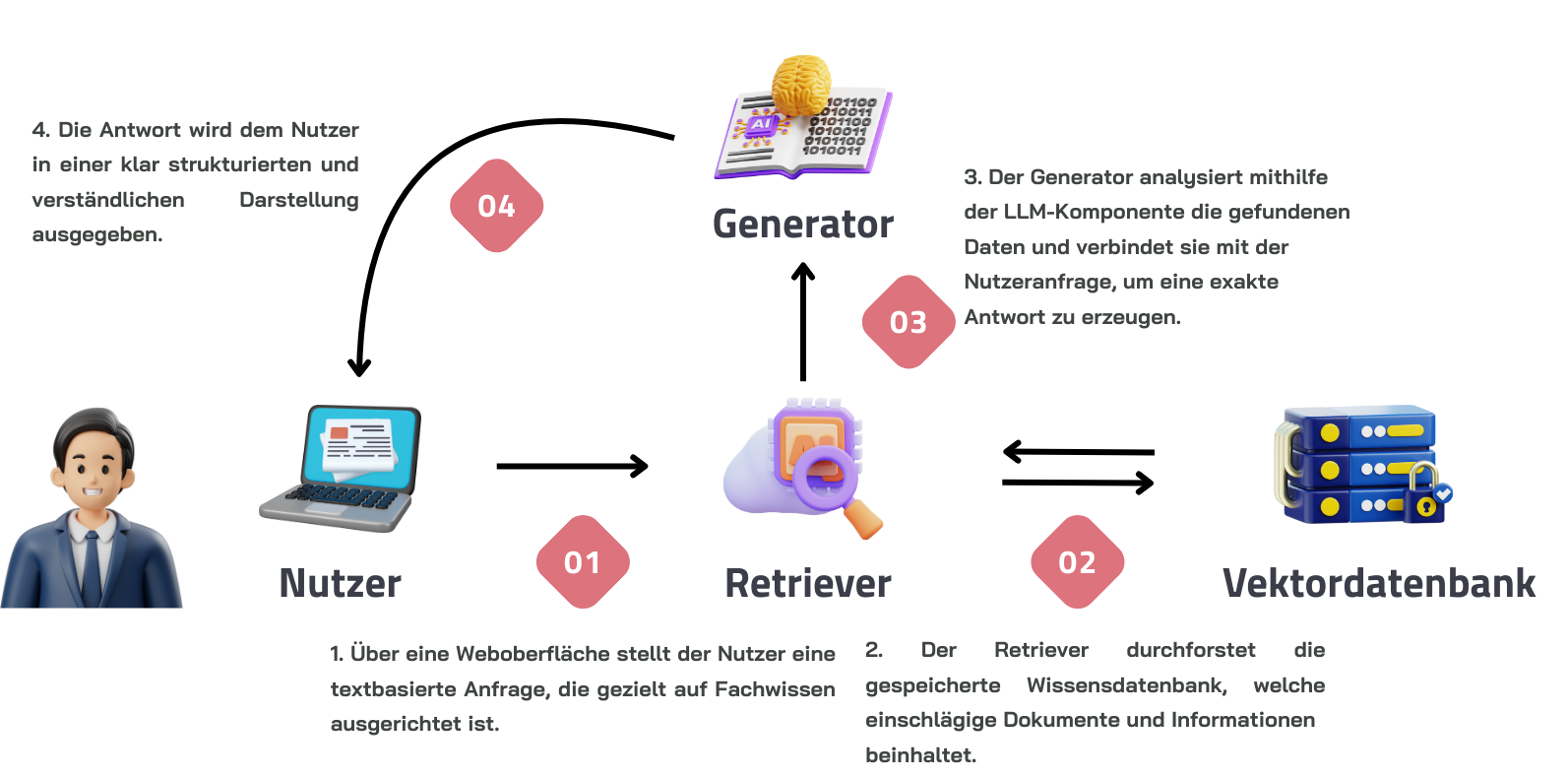

Die Funktionsweise eines RAG-Systems lässt sich in vier zentrale Schritte unterteilen:

1. Nutzeranfrage über Weboberfläche

Der Nutzer stellt über eine Weboberfläche eine textbasierte Anfrage, die gezielt auf Fachwissen ausgerichtet ist. Diese Anfrage wird zunächst in eine semantische Repräsentation (Vektor) umgewandelt, damit das System die inhaltliche Bedeutung verstehen kann – nicht nur die exakten Wörter.

2. Retriever durchforstet die Vektordatenbank

Der Retriever durchsucht die gespeicherte Wissensdatenbank, welche einschlägige Dokumente und Informationen beinhaltet. Diese Vektordatenbank enthält bereits vorverarbeitete und indexierte Wissensinhalte.

Beliebte Datenbanken für RAG sind z. B. Pinecone, Weaviate oder FAISS.

3. Generator analysiert mithilfe der LLM-Komponente

Der Generator analysiert mithilfe der LLM-Komponente die gefundenen Daten und verbindet sie mit der Nutzeranfrage, um eine exakte Antwort zu erzeugen. Das Modell integriert das abgerufene Wissen und bereitet eine präzise, kontextbasierte Antwort vor.

4. Strukturierte und verständliche Antwort

Die Antwort wird dem Nutzer in einer klar strukturierten und verständlichen Darstellung ausgegeben. Diese finale Antwort kombiniert das externe Wissen mit der Sprachkompetenz des LLMs.

Funktionsweise eines RAG-Systems: Die vier Schritte vom Nutzer über Retriever und Vektordatenbank zum Generator

💡 Beispiel - RAG-System in Aktion:

1. Nutzeranfrage: „Wie hoch ist die aktuelle Inflationsrate in Deutschland?"

2. Retriever-Suche: Durchsucht aktuelle Wirtschaftsdatenbank nach neuesten Inflationsdaten

3. Generator-Analyse: LLM verarbeitet gefundene Daten und kontextualisiert sie

4. Strukturierte Antwort: „Die aktuelle Inflationsrate in Deutschland beträgt 3,2% (Stand: Januar 2024), basierend auf den neuesten Daten des Statistischen Bundesamts."

Ohne RAG: Ein LLM würde mit veralteten Trainingsdaten antworten.

Mit RAG: Das System liefert aktuelle, verifizierte Daten in Echtzeit.

Vorteile von RAG-Systemen

RAG bringt eine ganze Reihe von Vorteilen mit sich, die es zu einem Gamechanger in der KI machen:

- ✅ Aktualität – Zugriff auf Live-Daten und aktuelle Informationen.

- ✅ Faktenbasierte Antworten – Reduktion von „Halluzinationen" (Fehlinformationen).

- ✅ Skalierbarkeit – Nutzung großer Wissensdatenbanken, ohne dass das Modell neu trainiert werden muss.

- ✅ Flexibilität – Einsetzbar in vielen Bereichen: Chatbots, Wissensmanagement, Healthcare, Finance, Legal Tech u. v. m.

Typische Einsatzgebiete von RAG

- Kundensupport: Chatbots, die auf Unternehmensdokumentationen und FAQs zugreifen.

- Unternehmenssuche: Intelligente Suche in internen Wissensdatenbanken.

- Healthcare: Ärzte können KI-gestützt aktuelle Studienergebnisse abrufen.

- Recht & Finanzen: Unterstützung durch präzise Recherche in komplexen Dokumenten.

Fazit: Warum RAG die Zukunft der KI ist

RAG-Systeme sind eine der spannendsten Entwicklungen im Bereich Generative AI. Sie lösen eine der größten Herausforderungen von LLMs: den Mangel an aktuellem und überprüfbarem Wissen.

Mit Retrieval-Augmented Generation wird die KI nicht nur „klug trainiert", sondern auch immer lernfähig, faktenbasiert und anpassbar.

Wer heute Chatbots, Assistenzsysteme oder Wissensplattformen aufbaut, kommt an RAG nicht vorbei – es ist der Schlüssel, um KI praxisnah und vertrauenswürdig einzusetzen.

Interesse an KI für Ihr Unternehmen?

Lassen Sie uns in einem kostenlosen Gespräch über Ihre KI-Projekte sprechen.